En un mercado donde el 89% de las búsquedas está en poder de Google, la llegada de los «resúmenes inteligentes» ha cambiado el modo de interactuar en las redes. Empresas, medios y negocios hacen uso de costosas estrategias que van desde el pago de servicios de publicidad, equipos creativos, hasta áreas de investigación para posicionar sus páginas en el buscador. Sin embargo, la llegada de esta tecnología ha provocado que las visitas a los portales sufran un descenso dramático al punto de reducir personal y buscar nuevas estrategias para afrontar la falta de clics.

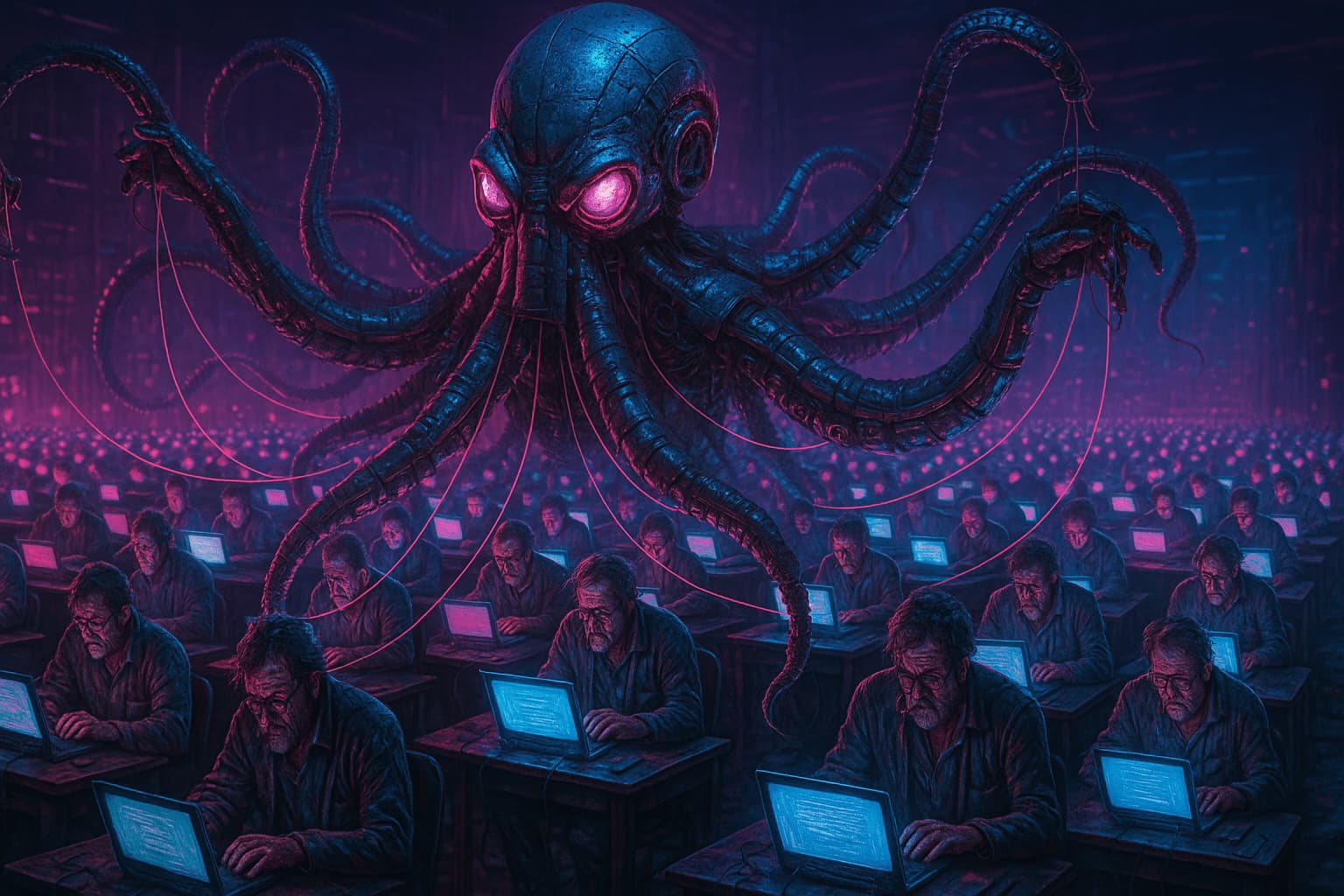

El uso de esta herramienta del gigante tecnológico concentra información de múltiples sitios y los presenta en un breve texto encima de los links que «alimentan» su idea haciendo innecesario la visita a su origen. Esta modalidad de alimentar los modelos de lenguaje (LLM) con material en línea ha planteado interrogantes sobre el uso de propiedad intelectual sin consentimiento y ha provocado denuncias por reducir el tráfico y poner en riesgo la sostenibilidad de redacciones.

Este particular cambio afecta a las redacciones de manera drástica transformando su forma de interactuar y de proteger su contenido contra el uso de la inteligencia artificial. La situación se asemeja a la vez que llegaron las app de viaje. A pesar de las resistencias por su marco regulatorio y a pesar de la presión de los taxistas, que pagaban costosos permisos, esta se impusieron como medio seguro, confiable y eficiente, provocando que muchas tropas de autos migraran a esta nueva tecnología.

La democratización de las síntesis automáticas

Como parte del proyecto Search Generative Experience (SGE) anunciado por Google I/O en mayo de 2023 las AI Overviews fueron lanzadas en EE.UU en Mayo del 2024. Un año después la plataforma amplía su oferta y lo deja disponible para más de 200 países y en más de 40 idiomas.

Este avance es una manera de mantenerse informado sin necesidad de llegar a la fuente original. Hechos con el propósito de facilitar, como resultado de concentrar grandes volúmenes de datos (que incluye búsquedas y preferencias de usuarios) de infinidad de sitios y presentarlo por encima de los resultados forma ordenada y entendible. Sin embargo, esto está afectando a las redacciones que recurren a costosos mecanismos para lograr posicionamiento que se ha manifestado en contra a causa de la caída de trafico de sus páginas.

Imagina que debes leer un libro y que no tienes tiempo. Hoy gracias a los modelos de lenguaje puedes obtener la trama, los plot point, diálogos y frases más relevantes sin necesidad de estar leyendo por horas. ¿Lo que sucede es lo mismo que leer un libro? No, pero muchos usuarios resumen con sistemas inteligentes porque lo hace de modo muy eficiente. Esto evita esfuerzo y gana tiempo. Bueno con los IA Overwievs sucede algo similar. Ya no es necesario leer cientos de hojas o visitar decenas de hipervínculos todo queda al alcance de una búsqueda. Los modelos de lenguaje como si se tratase de un zip, concentran y achican cualquier información y te la brinda en un texto breve y persuasivo. Pero ¿Cuál es el costo de esta simplificación?

Acordar o perecer

Portales afectados por esta situación han tomado medidas extremas buscando evitar la extinción inmediata hasta hallar otras alternativas. El New York Times y Amazon ha llegado a un acuerdo para que la empresa de Jeff Bezos utilice su contenido para entrenar sus modelos de inteligencia artificial. La suma ronda entre los 20 a 25 millones anuales y permite acceso a contenido actualizado.

Este escenario pone en riesgos oficios como el periodismo que convive entre costos y beneficios del uso de la inteligencia artificial. Editoriales como Reach, anunciaron el riesgo de 600 puestos de trabajo que incluye a 321 puestos editoriales vislumbrando un futuro incierto a la prensa que debe buscar alternativas a la falta de clics y tráfico que antes los mantenía.

¿Qué se puede hacer?

Este escenario produce debates que plantean las posibilidad de un nuevo protocolo de internet. En su época fueron TCP/IP y HTML. Ahora con otras siglas, este protocolo permitiría distinguir el tráfico de bots y bloquear solicitudes que impidan la creación de extractos inteligentes. De lograrse resolvería muchos de los problemas de pérdida de tráfico, sin embargo, se plantea la interrogante sobre su vulnerabilidad y el advenimiento de nuevas tecnologías que puedan evadir esas restricciones. Por otro lado, genera dudas sobre las Big Tech que se opongan a eso.

En este aspecto el Internet Engineering Task Force trabaja para resolver esta actualidad donde el avance tecnológico de la inteligencia artificial fomenta un ecosistema desigual y vertiginoso.

El tiempo apremia y no permite dormir. Organizaciones periodísticas que no pueden aguardar a innovaciones como Rolling Stone no se quedaron de brazos cruzados. Recientemente el propietario de la revista demandó a la empresa de Mountain View por el uso de su material para la generación de compilaciones inteligentes afirmando que tuvo un descenso de un tercio de sus suscriptores.

Esta es la primera demanda contra el buscador por la aplicación de algoritmos que involucra a revistas como Variety, Billboard y Rolling Stone, todas propiedad de Penske Media Corporation. Su Director Jay Penske afirmó «Tenemos la responsabilidad de luchar proactivamente por el futuro de los medios digitales y preservar su integridad, todo lo cual se ve amenazado por las acciones actuales de Google».

Esta demanda se acompaña de otros sitios que responsabilizan al buscador por el descenso de tráfico. Sin embargo, desde la empresa respondieron que esta innovación provoca las visitas a un espectro más amplio haciéndola más equitativa y mejorando la experiencia.

En este contexto, las demandas contra el buscador no han tenido el visto bueno de los jueces que impidieron que deba desprenderse de su explorador Chrome. Según sus competidores eso hubiese traído mayor transparencia y competitividad en un mercado prácticamente dominado por los productos de Alphabet.

Hecha la ley, hecha la trampa

Las Big Tech están presionando para que haya menos regulación y poder avanzar en una IA que compita con China. Propuestas de exención regulatoria ya están siendo presentadas por senadores norteamericanos, que buscan mitigar las regulaciones por al menos 2 años. Los que se oponen señalan buscan tratar a las personas como sujetos de prueba.

La pelea entre las Big Tech no está en su mejor momento. Con denuncias civiles que las responsabilizan por los malos consejos de los modelos de lenguaje que han provocado hasta muertes, y con avances regulatorios que ponen límites sobre su uso, las GAFAM (Google, Apple, Facebook (ahora Meta), Amazon y Microsoft) entretejen alianzas estrategias que permitan mayor libertad para el entrenamiento de sus nuevos modelos.

El uso de esta funcionalidad expone un escenario que se plantea entre eficiencia tecnológica y sostenibilidad editorial. Mientras usuarios y plataformas celebran el uso práctico y eficientes de búsquedas condesadas al instante, medios por el mundo luchan por mantener sus modelos de negocios. La armonía dependerá del equilibrio entre el reconocimiento de los contenidos creados por puestos de trabajo humano y el uso de las nuevas tecnologías. En esta encrucijada, tanto la calidad de información, la diversidad como la experiencia de usuario entran en juego.

Deja una respuesta