Este artículo es el primero de nuestra serie Alfabetización digital, donde explicamos las tecnologías que están transformando nuestra vida cotidiana. Sin tecnicismos innecesarios. Sin humo y con mirada crítica.

Todos hablan de inteligencia artificial. Los medios, los políticos, los vendedores de cursos; hablamos en el asado, el trabajo, en colectivo, pero si preguntas a la mayoría qué es exactamente la IA, las respuestas van desde «una computadora que piensa» hasta «el fin de la humanidad». Ninguna de las dos es correcta.

La inteligencia artificial no piensa. No siente. No entiende. Pero tampoco es un invento menor. Es, probablemente, la tecnología más transformadora desde la aparición de internet. Y como toda tecnología poderosa, merece ser comprendida, no solo consumida.

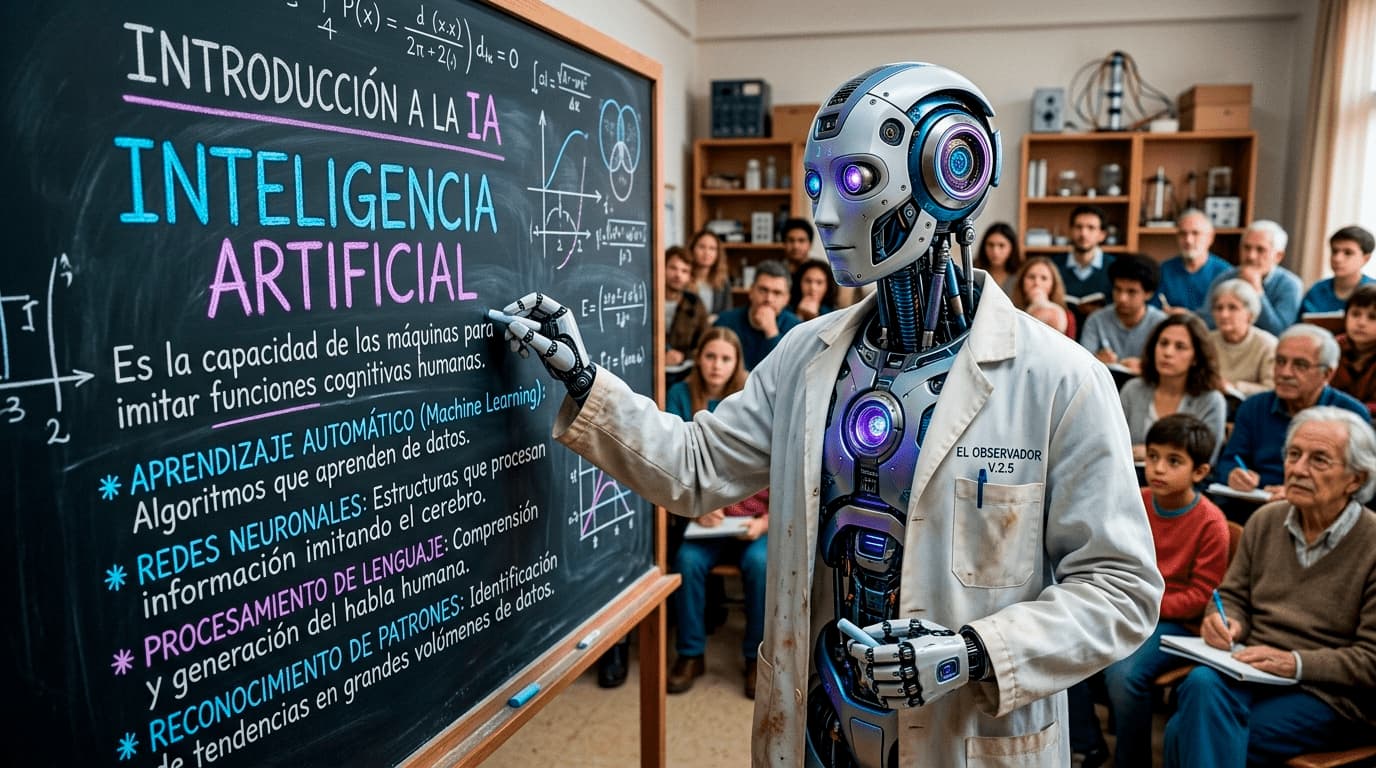

Empecemos por lo básico: ¿qué es la IA?

Definiciones hay muchas y todas llenas de contrastes, nosotros diremos que la inteligencia artificial es un campo de la informática que busca crear sistemas capaces de realizar tareas que, si las hiciera una persona, diríamos que requieren inteligencia: reconocer una cara en una foto, traducir un texto, recomendar una película, conducir un auto o mantener una conversación.

La palabra clave acá es simular.

La IA no replica la inteligencia humana; la imita en resultados específicos. Un programa de ajedrez puede ganarle al mejor jugador del mundo, pero no sabe que está jugando al ajedrez. No tiene idea de qué es un tablero, ni le importa ganar. Solo ejecuta cálculos matemáticos a una velocidad que nuestro cerebro no puede igualar.

Esa distinción importa. Porque cuando una empresa dice que su producto «tiene IA», lo que suele querer decir es que tiene un programa que aprendió a detectar patrones en datos. No que creó una mente artificial.

¿Cómo «aprende» una IA?

El método más usado hoy se llama aprendizaje automático (machine learning). La idea es simple en concepto, aunque compleja en ejecución: en vez de programar reglas una por una, le das a la computadora miles o millones de ejemplos y dejás que ella encuentre los patrones.

Imaginá que querés enseñarle a un programa a distinguir fotos de gatos y perros. No le escribís un manual («los gatos tienen bigotes, los perros tienen hocico largo»). Le mostrás 100.000 fotos etiquetadas — «esto es un gato», «esto es un perro» — y el sistema, a fuerza de repetición estadística, aprende a identificar las diferencias. No entiende qué es un gato. Pero puede señalarlo en una foto con más del 95% de precisión.

Esto funciona porque las computadoras son extraordinariamente buenas para encontrar correlaciones en cantidades enormes de datos. Mucho mejores que nosotros. Pero también son extraordinariamente malas para entender contexto, intención o significado. Ven el patrón, no la historia detrás del patrón.

¿Y ChatGPT? ¿Qué es la IA generativa?

Si el aprendizaje automático fue la primera gran revolución, la IA generativa es la segunda. Herramientas como ChatGPT, Gemini, Claude o Midjourney no solo analizan datos: crean contenido nuevo. Textos, imágenes, código, música, videos.

¿Cómo lo hacen? Los modelos de lenguaje como ChatGPT fueron entrenados con una cantidad descomunal de texto de internet: libros, artículos, foros, páginas web. A partir de todo ese material, el sistema aprendió a predecir qué palabra viene después de otra. Eso es, en esencia, lo que hace cuando te «responde»: no está pensando una respuesta; está calculando cuál es la secuencia de palabras más probable dado el contexto de tu pregunta.

Es un loro estadístico extraordinariamente sofisticado. Y eso no es un insulto: esa sofisticación produce resultados que a veces parecen genuinamente inteligentes. Pero también produce errores absurdos, datos inventados y respuestas que suenan perfectas pero son completamente falsas. En el mundo de la IA, a esto se le llama alucinaciones: el sistema genera información que no existe, con total confianza, porque su trabajo no es ser preciso sino ser coherente.

Los números: un mercado que no para de crecer

Para dimensionar de qué estamos hablando: el mercado global de la inteligencia artificial ronda los 391.000 millones de dólares, y se proyecta que crezca casi nueve veces para 2033. En América Latina, la inversión en infraestructura de IA ya supera los 15.000 millones de dólares, con Chile, Brasil y México a la cabeza de la adopción regional.

Argentina, según el Índice Latinoamericano de IA (ILIA), se ubica en la categoría de «adoptantes», con una puntuación de 55,77. No lideramos, pero tampoco estamos afuera. En el terreno empresarial, herramientas como ChatGPT (con más del 42% de adopción en la región) están cambiando cómo se trabaja en marketing, desarrollo de software y atención al cliente.

Y no es solo un fenómeno corporativo. Aproximadamente una de cada seis personas en el mundo usaba herramientas de IA generativa a finales de 2025. Esa cifra sigue creciendo.

Lo que la IA puede hacer (y lo que no)

Acá es donde conviene ser honestos, porque la industria tecnológica tiene un historial largo de prometer más de lo que entrega.

Copiar, optimizar, reemplazar

Mientras escribimos este artículo, Microsoft acaba de anunciar algo inédito en sus 51 años de historia: un programa de retiro voluntario para aproximadamente 8.750 empleados en Estados Unidos. El criterio para ser elegible es que la suma de tu edad y tus años en la empresa sea al menos 70. En otras palabras: los que más saben, los que más experiencia tienen, son los primeros invitados a irse.

¿La razón? Liberar presupuesto para invertir en infraestructura de inteligencia artificial. El mismo día que anunció los retiros, Microsoft comunicó una inversión de 18.000 millones de dólares en centros de datos e IA en Asia-Pacífico. No es un caso aislado: Meta despidió 8.000 empleados la misma semana, Amazon recortó 30.000 en el último año, y Block redujo su plantilla un 40% argumentando que equipos más chicos rinden más «con apoyo de IA».

La paradoja es brutal: las empresas que construyen la inteligencia artificial están usando esa misma tecnología como argumento para prescindir de personas. La IA no solo copia texto o genera imágenes; también reemplaza puestos de trabajo reales. No en un futuro lejano. Ahora. Y no empieza por los trabajos más simples, como se predecía, sino por roles técnicos, administrativos y de soporte que las empresas consideran «automatizables».

Esto no significa que la IA vaya a eliminar todos los empleos. Significa que está redistribuyendo el poder dentro de las organizaciones. Menos personas, más máquinas, más ganancias concentradas. Y esa redistribución no es un accidente técnico: es una decisión empresarial.

Por qué importa que entiendas esto?

No hace falta ser programador para necesitar entender la IA. Hace falta ser ciudadano. Porque la inteligencia artificial ya está tomando decisiones que te afectan: qué noticias ves, qué precio te ofrecen, si te aprueban un crédito, si tu currículum pasa el primer filtro de selección, qué contenido le muestra TikTok a tus hijos.

Y la mayoría de esas decisiones ocurren en una caja negra. No sabés cómo se tomaron, con qué datos, ni con qué sesgos. La empresa que diseñó el algoritmo probablemente tampoco lo sepa del todo: los modelos de aprendizaje automático son tan complejos que a veces ni sus creadores pueden explicar por qué toman una decisión específica.

Esa opacidad es un problema político, no solo técnico. Y por eso creemos que la alfabetización digital no es un lujo ni un hobby para curiosos: es una herramienta de defensa.

El problema de la neutralidad

Hay una frase que repetimos seguido en La Voz del Observador: la tecnología no es neutral. Y la IA es el mejor ejemplo.

Los datos con los que se entrena un modelo de IA reflejan los sesgos del mundo real. Si le mostrás a un sistema miles de currículums de un sector donde históricamente contrataron más hombres, el sistema va a aprender que «hombre» es un predictor de buen candidato. No por maldad, sino por estadística.El sistema no discrimina con intención; discrimina con precisión.

Esto ya pasó. Amazon tuvo que descartar un sistema de selección de personal basado en IA porque penalizaba sistemáticamente a candidatas mujeres. Y no es un caso aislado. Los sesgos raciales en sistemas de reconocimiento facial, los algoritmos que asocian ciertos barrios con mayor riesgo crediticio, las IA que generan imágenes donde todos los científicos son hombres blancos: todo esto es consecuencia de entrenar máquinas con datos que reflejan desigualdades históricas.

Lo que no está en los datos, no existe

Hay un problema todavía más profundo que el sesgo: la invisibilidad. Si la inteligencia artificial aprende exclusivamente de datos, todo lo que no fue registrado, medido o digitalizado simplemente no existe para ella.

Pensá en una comunidad rural del norte argentino que no tiene conectividad, donde los trámites se hacen en papel y las historias se transmiten de boca en boca. Para un modelo de IA, esa comunidad es un espacio en blanco. Sus problemas no aparecen en las estadísticas. Sus necesidades no figuran en ningún dataset. Sus voces no están en el corpus de entrenamiento de ningún modelo de lenguaje.

Lo mismo pasa con idiomas minoritarios, con economías informales, con poblaciones sin acceso a internet, con historias que nunca se escribieron en formato digital. La IA no discrimina solo por sesgo estadístico; discrimina por omisión. Lo que no fue contado, no cuenta.

Y esto tiene consecuencias concretas. Cuando un gobierno usa IA para asignar recursos, priorizar zonas de inversión o diseñar políticas públicas basándose en datos, las comunidades invisibilizadas quedan, una vez más, afuera. La tecnología no corrige la desigualdad de base; la automatiza. La vuelve más eficiente. Y, lo que es peor, la vuelve invisible detrás de una decisión que parece «objetiva» porque la tomó un algoritmo.

¿Qué sigue?

Este es solo el primer artículo de nuestra serie Alfabetización digital. En las próximas entregas vamos a meternos en temas concretos: cómo usar herramientas como ChatGPT de manera efectiva (y crítica), qué son los deepfakes y cómo detectarlos, y qué datos estás entregando sin saberlo cada vez que usás una app «gratuita».

La idea no es que te conviertas en experto en IA. La idea es que la próxima vez que alguien te diga que «la IA va a reemplazar tu trabajo» o que «ChatGPT siempre tiene razón», tengas las herramientas para hacer las preguntas correctas.

Porque en un mundo donde las máquinas simulan entender, lo más humano que podemos hacer es insistir en comprender.

Ricardo Ledesma es periodista digital, creador de contenido y ayudante de cátedra en Nuevas Tecnologías de la Información (UNDAV), donde investiga el uso de IA generativa en el periodismo.

Deja una respuesta